在人工智能与边缘计算的交汇点上,微软近日迈出了重要一步,宣布推出专为NPU(神经处理单元)优化的DeepSeek-R1模型。这一创新之举不仅标志着微软对边缘计算潜力的深刻洞察,也预示着搭载高通骁龙X芯片的Copilot+ PC将率先迎来一场技术革命,随后英特尔酷睿Ultra 200V等平台也将陆续加入这一行列。

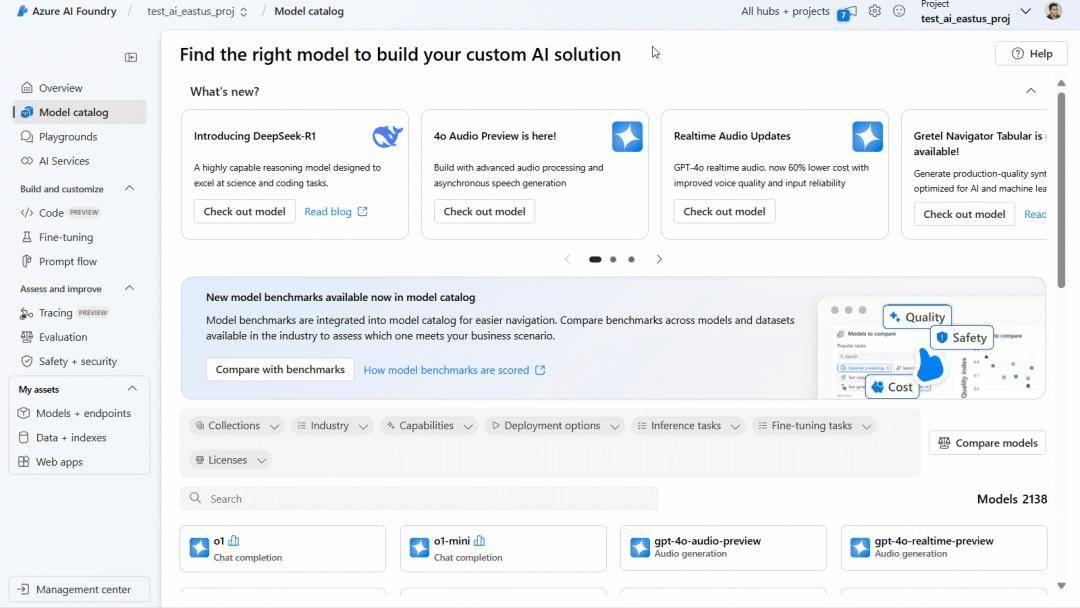

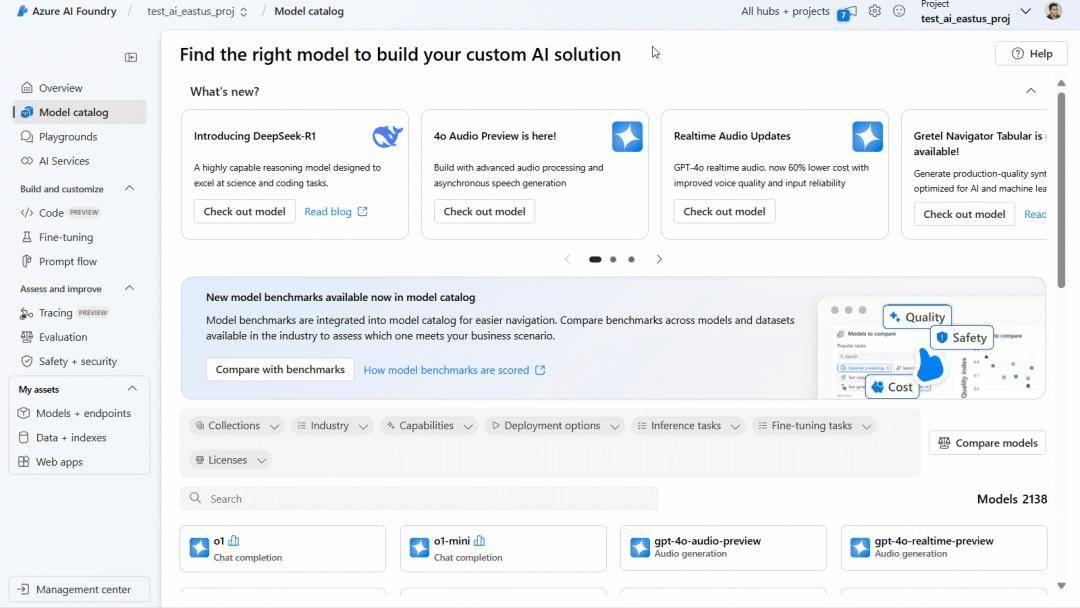

微软通过官方渠道宣布,DeepSeek-R1的首个版本——DeepSeek-R1-Distill-Qwen-1.5B,已正式入驻Azure AI Foundry和GitHub,供开发者下载使用。同时,微软还透露,参数规模更大的7B和14B版本也即将面世,这将极大地助力开发者充分挖掘Copilot+ PC中NPU的强大性能。

微软强调,Copilot+ PC上的NPU开创了一种全新的AI应用范式。在这一范式下,生成式AI不仅能够在被调用时迅速响应,还能支持半连续运行的服务模式。这一特性使得开发者能够利用AI推理引擎,构建出更加主动、持续的用户体验。

为了实现这一目标,微软在Phi Silica项目的基础上,积累了丰富的推理优化经验和技术。这些经验和技术被巧妙地融入到针对NPU优化的DeepSeek模型中,包括模型分割以实现性能与效率的最佳平衡、低比特率量化以及Transformer模型到NPU的映射等。微软还借助Windows Copilot Runtime(WCR)和ONNX QDQ格式,在多样化的Windows生态系统中实现了模型的广泛部署。

为了让更多开发者能够轻松体验DeepSeek模型的魅力,微软提供了便捷的下载途径。只需在Visual Studio Code中安装AI Toolkit扩展,开发者即可轻松获取这一创新成果。同时,以ONNX QDQ格式优化的DeepSeek模型也将很快出现在AI Toolkit的模型目录中,供开发者直接从Azure AI Foundry中拉取使用。

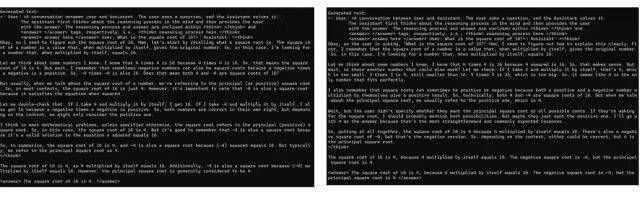

微软还通过实例展示了原始模型与NPU优化模型之间的差异。在相同的提示下,原始模型和NPU优化模型给出了略有不同的响应。这一对比不仅彰显了NPU优化模型在推理能力上的提升,也进一步验证了微软在模型优化方面的深厚实力。